用的着心跳线,1000M网卡和VERITAS吗?

发表于:2007-05-26来源:作者:点击数:

标签:

这是我做的一个小结,我认为用不上心跳线,1000M网卡和VERITAS了: 一、现场条件 1、硬件配置: 两台SUNF280R服务器(SPARCIII+900MHz/8MCache/2048M/2X36.4GHD) 一台SUNA1000磁盘阵列(SG-XARY171A-145G),总容量145G,出厂设好RAID5 我们的系统很大连了很多设

这是我做的一个小结,我认为用不上心跳线,1000M网卡和VERITAS了:

一、 现场条件

1、 硬件配置:

两台SUN F280R服务器(SPARC III+ 900MHz/8M Cache/2048M/2X36.4GHD)

一台SUN A1000磁盘阵列(SG-XARY171A-145G),总容量145G,出厂设好RAID5

我们的系统很大连了很多设备与终端

2、 软件版本:

Solaris 5.8

Oracle 8.1.7

oursoft V2.52.01c

3、 IP地址分配:

dbserver: 172.31.1.13 255.255.255.240

apserver: 172.31.1.14 255.255.255.240

MP1: 172.31.1.1

MP2: 172.31.1.9

MP3: 172.31.1.2

MP4: 172.31.1.10

Test IP: 172.31.1.201 (在客户端配两个IP地址用探针ProbeApp252.exe)

LMT IP: 172.31.1.221

Client PC: 172.31.1.12 255.255.255.240 + 172.31.1.201 255.255.255.0

4、 项目:OUR ITEM

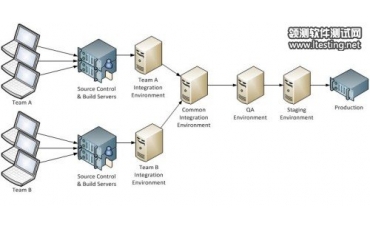

OMCR(V2.0)系统分为三个功能模块,分别是应用服务器模块,数据库服务器模块和通讯服务器模块,在双机的情况下,上述三个模块可以相互组合,分别运行在两台服务器中,其中将数据库服务器模块独立出来,形成数据库/应用服务器组(通讯服务器与应用服务器合并)的架构,这种架构在实际运行过程中显得比较合理

两台服务器分别运行数据库分为模块和应用+通讯服务模块。磁盘阵列同时连接在两台服务器上,磁盘阵列不是必备的设备,但推荐使用。数据库服务器上必须安装ORACLE服务器软件,应用服务器中可以只安装ORACLE客户端(安装ORACLE服务器也是可以的);OMCR(V2.0)软件必须完整的安装在两台服务器上。如果配置了磁盘阵列,则OMCR的数据文件推荐安装在磁盘阵列上,否则需要安装在数据库服务器中。

上述结构可以实现双机运行的负荷分担,以及在一台服务器中OMCR进程全部异常时的进程迁移,但是在一台服务器完全宕机的情况下,迁移不能保证OMCR系统的正确运行。

根据印度SPICE项目的现场条件决定在两台服务器内置硬盘中做RAID1镜像,将RAID 5磁阵连数据服务器,并安装数据库实例omc于其中。

二、 先不连磁阵分别在应用服务器和数据服务器上安装Solaris 5.8

分区时只对c1t0d0一块硬盘进行分区,并将c1t0d0s7预留给metadb

选择custom自定义安装,并选中Solstice DiskSuite 4.2.1 (做RAID 1用)

Solaris装完后

#format时看到的两块内置硬盘:

Searching for disks...done

AVAILABLE DISK SELECTIONS:

0. c1t0d0 <SUN36G cyl 24620 alt 2 hd 27 sec 107>

/pci@8,600000/SUNW,qlc@4/fp@0,0/ssd@w21000004cffa0f5d,0

1. c1t1d0 <SUN36G cyl 24620 alt 2 hd 27 sec 107>

/pci@8,600000/SUNW,qlc@4/fp@0,0/ssd@w21000004cfc34a4a,0

format>0

format>p

其中第一块硬盘c1t0d0分区表如下:

partition>p

Part Tag Flag Cylinders Size Blocks

0 root wm 0 - 1088 1.50GB (1089/0/0) 3146121

1 swap wu 1089 - 3992 4.00GB (2904/0/0) 8389656

2 backup wm 0 - 24619 33.92GB (24620/0/0) 71127180

3 var wm 3993 - 4355 512.06MB (363/0/0) 1048707

4 usr wm 4356 - 6533 3.00GB (2178/0/0) 6292242

5 unassigned wm 6534 - 8711 3.00GB (2178/0/0) 6292242

6 home wm 8712 - 22181 18.56GB (13470/0/0) 38914830

7 unassigned wm 0 0 (0/0/0) 0

安装完后再给Solaris打补丁

三、 做内置硬盘的镜像RAID 1

1、格式化c1t0d0s7分区

#format

选c1t0d0

查看分区表(结果就是上面列出来的表)

format>p

选预留的c1t0d0s7

partition>7

Enter partition id tag[unassigned]:

Enter partition permission flags[wm]:

开始柱面紧接c1t0d0s6后下一柱面

start cyl 22182

大小用总数24619减c1t0d0s6最后一个柱面

size 2438c

标识并命名(要用“ ”号括起来)

partition>label

partition>name

partition>q

分区表存盘退出

format>save

format>q

2、按c1t0d0同样的分区表对另一块硬盘c1t1d0进行分区

#prtvtoc /dev/rdsk/c1t0d0s2 | fmthard -s - /dev/rdsk/c1t1d0s2

3、在两块硬盘的最后分区中各建4个镜像库

#metadb -af -c 4 c1t0d0s7

#metadb -af -c 4 c1t1d0s7

建完后可以查看

# metadb

flags first blk block count

a u 16 1034 /dev/dsk/c1t0d0s7

a u 1050 1034 /dev/dsk/c1t0d0s7

a u 2084 1034 /dev/dsk/c1t0d0s7

a u 3118 1034 /dev/dsk/c1t0d0s7

a u 16 1034 /dev/dsk/c1t1d0s7

a u 1050 1034 /dev/dsk/c1t1d0s7

a u 2084 1034 /dev/dsk/c1t1d0s7

a u 3118 1034 /dev/dsk/c1t1d0s7

4、做镜像分区

#metainit -f d51 1 1 c1t0d0s0

#metainit d52 1 1 c1t1d0s0

#metainit d1 -m d51

#metainit -f d53 1 1 c1t0d0s1

#metainit d54 1 1 c1t1d0s1

#metainit d2 -m d53

#metainit -f d55 1 1 c1t0d0s3

#metainit d56 1 1 c1t1d0s3

#metainit d3 -m d55

#metainit -f d57 1 1 c1t0d0s4

#metainit d58 1 1 c1t1d0s4

#metainit d4 -m d57

#metainit -f d59 1 1 c1t0d0s5

#metainit d60 1 1 c1t1d0s5

#metainit d5 -m d59

#metainit -f d61 1 1 c1t0d0s6

#metainit d62 1 1 c1t1d0s6

#metainit d1 -m d51

5、定义启动引导分区

#metaroot d1

6、改文件/etc/vfstab内容为:

#/dev/dsk/c1d0s2 /dev/rdsk/c1d0s2 /usr ufs 1 yes -

fd - /dev/fd fd - no -

/proc - /proc proc - no -

/dev/md/dsk/d2 - - swap - no -

/dev/md/dsk/d1 /dev/md/rdsk/d1 / ufs 1 yes -

/dev/md/dsk/d4 /dev/md/rdsk/d4 /usr ufs 1 yes -

/dev/md/dsk/d3 /dev/md/rdsk/d3 /var ufs 1 yes -

/dev/md/dsk/d6 /dev/md/rdsk/d6 /export/home ufs 2 yes -

/dev/md/dsk/d5 /dev/md/rdsk/d5 /opt ufs 2 yes -

swap - /tmp tmpfs - yes -

lock所有已mounted的UFS文件系统

#lockfs -fa

7、关机重启

#sync

#shutdown -g0 -y -i6

然后会看到类似:

forceload of misc/md_trans failed

forceload of misc/md_raid failed

forceload of misc/md_hotspares failed

的提示信息(执行/etc/profile时产生),这是正常的,因为现在还不需要这些模块。

8、连接mirror分区到第二块硬盘

#metattach d1 d52

#metattach d2 d54

#metattach d3 d56

#metattach d4 d58

#metattach d5 d60

#metattach d6 d62

9、查看镜像情况

#metastat

这时mirror会自动同步,能观察到硬盘读写频繁,此时若执行操作机器反应速度会变慢,是正常的,最后d6同步完100%结束。

四、 安装StorEdge Raid Manager 6.22

在服务器上可用#admintool 或#/usr/sbin/swmtool图形化安装

在TELNET终端上可用

#/usr/sbin/pkgadd –d /cdrom/raid_manager_6_22/Product安装

完成安装下次启动后生效

#sync

#shutdown –g0 –y –i5

五、 安装外置磁阵

先对照随机资料检查磁阵,主要是看SCSI号的设置,有的型号是用DIP开关,对照文档确认左边和右边的硬盘没有冲突(除了磁阵的安装手册外还另有几页纸注明安装手册第X页的第X张表需要更正),印度现场磁阵箱的背面有Scroll式switch(SCSI ID=4),只有两个SCSI口。

如果需要安装SCSI卡或网卡,就先关机插上SCSI卡和网卡。

如是SUN的卡,Solaris应可自动识别,其它的卡随机会有驱动程序和手册。

在断电情况下连磁阵背面SCSI口到一台服务器,另一个SCSI口接上TERMINAL终端电阻。

磁阵加电,服务器加电,开机时STOP+A,然后

ok probe-scsi-all

如果正确列出内置硬盘、磁阵(如磁阵已做好RAID 5,只能看到一个)、光驱就说明Solaris可正确识别。否则:

ok set-defaults (eeprom中所用参数用默认值)

ok setenv auto-boot? false (或#eeprom auto-boot?=false让机器启动时自动停在eeprom状态)

ok reset-all

如果还不行,就试着:

ok setenv scsi-initiator-id 6 (如需将磁阵连两台服务器,在连第二台服务时要修改此值)

再 ok probe-scsi-all

如果还不能正确列出Targets,最后只有换拔码了,总之probe正常, #format时才能看到,才可以使用。正常后:

ok boot –r

启动时能看到Raid 的守护进程载入内存及Raid初始化的信息。

启动好后执行

#dmesg|more

可以看到以下字样:

Jun 1 13:23:13 dbserver scsi: [ID 365881 kern.info] <Symbios-StorEDGEA1000-0

301 cyl 52037 alt 2 hd 64 sec 64>

运行Raid Manager 6.22

#/usr/lib/osa/bin/rm6

能识别出磁阵RAID的名称,识别Raid Level为5,并显示1,0、1,1、2,0、2,1四块硬盘matrix

六、 安装ORACLE和OMCR的准备工作

1、 在两台服务器中分别创相同的组和用户

#groupadd –g 201 ointall

#groupadd –g 202 dba

#groupadd –g 203 omc

#useradd –d /export/home/oracle –m –g oinstall –u 201 oracle

#useradd –d /export/home/omc –m –g omc –u 202 omc

#passwd oracle

#passwd omc

#su – omc

$mkdir /export/home/omc/tmp

$mkdir /export/home/omc/tmp/ftp

$exit

#useradd –d /export/home/omc/tmp/ftp –m –g omc –u 203 ftpuser

#passwd ftpuser

#admintool或查/etc/passwd文件确认:

oracle用户属于组oinstall和组dba

组omc包括用户omc和ftpuser

2、 按要求修改/etc/profile和/etc/system文件

注意profile文件中

ORACLE_BASE=/oracleapp/u01/app/oracle要根据现场情况进行修改

ORACLE_BASE=/export/home/oracle/u01

以oracle用户创建目录

$mkdir /export/home/oracle/u01

在dbserver上再创建目录

$mkdir /export/home/oracle/u02

$su

#chown –R oracle:oinstall /export/home/oracle/u02

#mkdir /opt/bin

#chmod –R 755 /opt/bin

3、 修改/etc/.net/hosts文件

数据库服务器 应用服务器

127.0.0.1 localhost172.31.1.13 dbserver loghost172.31.1.14 apserver 127.0.0.1 localhost172.31.1.14 apserver loghost172.31.1.13 dbserver

4、创建磁阵上的文件系统并mount到指定点,以供omc数据库实例使用

#hostname

dbserver

# format

Searching for disks...done

AVAILABLE DISK SELECTIONS:

0. c1t0d0 <SUN36G cyl 24620 alt 2 hd 27 sec 107> mirror

/pci@8,600000/SUNW,qlc@4/fp@0,0/ssd@w21000004cf36d762,0

1. c1t1d0 <SUN36G cyl 24620 alt 2 hd 27 sec 107>

/pci@8,600000/SUNW,qlc@4/fp@0,0/ssd@w21000004cffb8368,0

2. c4t4d0 <Symbios-StorEDGEA1000-0301 cyl 52037 alt 2 hd 64 sec 64>

/pci@8,700000/scsi@2,1/sd@4,0

Specify disk (enter its number): 2

selecting c4t4d0

[disk formatted]

format> p

partition> p

Current partition table (original):

Total disk cylinders available: 52037 + 2 (reserved cylinders)

Part Tag Flag Cylinders Size Blocks

0 root wm 0 - 63 128.00MB (64/0/0) 262144

1 swap wu 64 - 127 128.00MB (64/0/0) 262144

2 backup wu 0 - 52036 101.63GB (52037/0/0) 213143552

3 unassigned wm 0 0 (0/0/0) 0

4 unassigned wm 0 0 (0/0/0) 0

5 unassigned wm 0 0 (0/0/0) 0

6 usr wm 128 - 52036 101.38GB (51909/0/0) 212619264

7 unassigned wm 0 0 (0/0/0) 0

partition> q

format> q

出厂时磁阵已format,在要使用的数据分区上创建ufs文件系统

#newfs /dev/rdsk/c4t4d0s6

改/etc/vfstab为

#/dev/dsk/c1d0s2 /dev/rdsk/c1d0s2 /usr ufs 1 yes -

fd - /dev/fd fd - no -

/proc - /proc proc - no -

/dev/md/dsk/d2 - - swap - no -

/dev/md/dsk/d1 /dev/md/rdsk/d1 / ufs 1 yes -

/dev/md/dsk/d4 /dev/md/rdsk/d4 /usr ufs 1 yes -

/dev/md/dsk/d3 /dev/md/rdsk/d3 /var ufs 1 yes -

/dev/md/dsk/d6 /dev/md/rdsk/d6 /export/home ufs 2 yes -

/dev/md/dsk/d5 /dev/md/rdsk/d5 /opt ufs 2 yes -

swap - /tmp tmpfs - yes -

/dev/dsk/c4t4d0s6 /dev/rdsk/c4t4d0s6 /export/home/oracle/u02 ufs 2 yes -

装载磁阵

#mount /export/home/oracle/u02

七、 按要求在dbserver上安装oracle 8.1.7

创建数据库时选择/export/home/oracle/u02目录

安装完后修改/export/home/oracle/u01/network/admin/tnsnames.ora配置如下:

OMC =

(DESCRIPTION =

(ADDRESS_LIST =

(ADDRESS = (PROTOCOL = TCP)(HOST = 172.31.1.13)(PORT = 1521))

)

(CONNECT_DATA =

(SERVICE_NAME = omc)

)

)

再复制数据库管理软件到应用服务器

$hostname

dbserver

$id -un

oracle

$pwd

/export/home/oracle

$tar –cvf oracle817.tar ./u01/*

$rlogin apserver

$hostname

apserver

$pwd

/export/home/oracle

$ftp dbserver

ftp>bin

ftp>get oracle817.tar

$tar –xvf oracle817.tar

八、 OMCR安装,表空间与表的创建及公共设置

1、 按要求在两台服务器上安装完整的omcr

修改/export/home/omc/.profile文件,以omc用户重登录,复制omcr软件并解压,修改/export/home/omc/conf/syscfg.ini文件权限

2、 在数据服务器上创表空间及表

修改/export/home/omc/sql/define.sql文件:

define schema = '2'; (设定大模式)

tablespace='/export/home/oracle/u02/oradata/omc/'

$pwd

/export/home/omc/sql

$sqlplus sys/oracle@omc

sqlplus>@setup.sql /export/home/omc/sql/ /export/home/oracle/u02/oradata/omc/;

3、amp进程属性设置

安装完OMCR系统软件后,需要对$OMCHOME/bin/amp进程的属性进行修改,如下:

chown root /export/home/omc/bin/amp

chmod u+s /export/home/omc/bin/amp

使用ls命令查看amp状态时显示:

ls –l amp

-rwsr-xr-x 1 root omc 606208 4月 10 09:30 amp

则修改完成。

3、 共享库连接设置

由于amp属主修改成root后,amp的一些共享库连接将会丢失,使用ldd命令查看时,

ldd amp

libutility.so => (文件没有发现)

libpthread.so.1 => /usr/lib/libpthread.so.1

libxnet.so.1 => /usr/lib/libxnet.so.1

librt.so.1 => /usr/lib/librt.so.1

libgen.so.1 => /usr/lib/libgen.so.1

libvos.so => (文件没有发现)

libafsm.so => (文件没有发现)

libCrun.so.1 => /usr/lib/libCrun.so.1

libm.so.1 => /usr/lib/libm.so.1

libw.so.1 => /usr/lib/libw.so.1

libthread.so.1 => /usr/lib/libthread.so.1

libc.so.1 => /usr/lib/libc.so.1

libaio.so.1 => /usr/lib/libaio.so.1

libdl.so.1 => /usr/lib/libdl.so.1

libsocket.so.1 => /usr/lib/libsocket.so.1

libnsl.so.1 => /usr/lib/libnsl.so.1

libmp.so.2 => /usr/lib/libmp.so.2

/usr/platform/SUNW,Ultra-5_10/lib/libc_psr.so.1

对于出现“文件未发现”的共享库,需要在/usr/lib命令目录中为其建立相应的连接。具体做法为:

以root用户执行:

ln –s /export/home/omc/lib/libvos.so /usr/lib/libvos.so

ln –s /export/home/omc/lib/libafsm.so /usr/lib/libafsm.so

ln –s /export/home/omc/lib/libutility.so /usr/lib/libutility.so

(如果创建时提示/usr/lib/lib***.so不存在,cd /usr/lib后再执行就可以了)

执行完成后,以omc用户再次执行ldd amp 命令,检查共享库连接情况,如果不再出现“文件未发现”则表明执行成功。

4、 OURcfg.ini设置

[GENERAL]

OURNum = 12

MComOUR = 1

[OUR1]

OURID = 101

IsRemote = 0

ModuleNum = 2

LocalModuleNum = 2

IP1 = 172.31.1.1 172.31.1.9

IP2 = 172.31.1.2 172.31.1.10

BmfRecePno = 90

BmfSendPno = 91

ModuleID1 = 1

ModuleID2 = 2

ModuleID3 = 3

ModuleID4 = 4

5、 dbcfg.ini设置

[DATABASE]

DBMSTYPE = ORACLE

DBINSTANCE = OMC

DIFVERSION = V1.0

DBVERSION = Build 765 - 2.52.001b

USERNAME = omc@omc

PASSWORD = omc

九、应用服务器配置

1、NFS服务配置

在Solaris缺省安装条件下,NFS的服务器和客户端启动脚本均在初始启动目录中,该启动脚本一般位于如下目录:

/etc/rc2.d/SXXnfs.client

/etc/rc3.d/SXXnfs.server

其中XX为一整数。

查看NFS是否已经启动,使用如下命令:

#ps –ef | grep nfs

如果显示如下:

daemon 193 1 0 4月06 ? 0:00 /usr/lib/nfs/statd

root 189 1 0 4月06 ? 0:00 /usr/lib/nfs/lockd

则说明NFS的客户端已经启动;

如果显示如下:

daemon 193 1 0 4月 06 ? 0:00 /usr/lib/nfs/statd

root 189 1 0 4月 06 ? 0:00 /usr/lib/nfs/lockd

root 448 1 0 4月 06 ? 0:00 /usr/lib/nfs/mountd

root 450 1 0 4月 06 ? 0:00 /usr/lib/nfs/nfsd -a 16

则说明NFS的客户端和服务器都已启动。

服务器是否启动,关键是看NFS服务器的配置文件是否配置。在OMCR双机环境下,数据库服务器不需要启动NFS服务器,应用服务器需要启动NFS服务器。具体做法如下:

在应用服务器中,以root用户编辑/etc/dfs/dfstab文件,在其中增加如下文字:

share -F nfs -o rw -d "OMCR AP Server ftp" /export/home/omc/tmp/ftp

share -F nfs -o rw -d "OMCR AP Server pmhist" /export/home/omc/tmp/pmhist

share -F nfs -o rw -d "OMCR AP Server pmmeas" /export/home/omc/tmp/pmmeas

share -F nfs -o rw -d "OMCR AP Server fmbak" /export/home/omc/tmp/bak/fm

保存退出后,将上述文字按命令逐个执行一次。

如果上述目录不存在请事先创建。

执行命令/usr/sbin/showmount –e 查看共享是否成功。如果没有成功,请进行如下操作:

a) 以root身份

b) 进入/etc/rc3.d目录

c) 执行SXXnfs.server stop

d) 执行SXXnfs.server start

2、syscfg.ini修改

[LOCAL]

Server = 1

MNo = 129

NMDomain = 124

NMDomainAlias = Domain124

IP = 172.31.1.14

保证两台服务器的NMDomain取值相同,MNo取值不同

3、ampcfg.ini修改

[MODULE]

MaxModule = 3

Module1 = COM

Module2 = DB

Module3 = AP

[LOAD]

MaxLoad = 2

Load1 = COM

Load2 = AP

其他配置项保持不变,如果要禁用OMCR的迁移功能,则将ampcfg.ini中所有MaxTakeover项设置为0

十、数据库服务器配置

1、NFS客户配置

缺省情况NFS客户端会被自动启动,检查方法参看9小节,如果没有启动,则以root用户身份执行/etc/rc2.d/SXXnfs.client start,其中XX为一整数,具体查看该目录下文件。

以omc用户将原ftp,pmhist,pmmeas目录改名或删除,再进行目录的链接:

ln –s /net/apserver/export/home/omc/tmp/ftp /export/home/omc/tmp/ftp

ln –s /net/apserver/export/home/omc/tmp/pmhist /export/home/omc/tmp/pmhist

ln –s /net/apserver/export/home/omc/tmp/pmmeas /export/home/omc/tmp/pmmeas

ln –s /net/apserver/export/home/omc/tmp/bak/fm /export/home/omc/tmp/bak/fm

或者通过mount命令进行挂接(以root用户),具体如下:

# mount apserver: /export/home/omc/tmp/ftp /export/home/omc/tmp/ftp

# mount apserver: /export/home/omc/tmp/pmmeas /export/home/omc/tmp/pmmeas

# mount apserver: /export/home/omc/tmp/pmhist /export/home/omc/tmp/pmhist

# mount apserver: /export/home/omc/tmp/bak/fm /export/home/omc/tmp/bak/fm

2、syscfg.ini的调整

[LOCAL]

Server = 1

MNo = 130

NMDomain = 124

NMDomainAlias = Domain124

IP = 172.31.1.13

[LOCAL]小节中,保证两台服务器的NMDomain取值相同,MNo取值不同。

3、 ampcfg.ini的调整

[MODULE]

MaxModule = 3

Module1 = COM

Module2 = DB

Module3 = AP

[LOAD]

MaxLoad = 1

Load1 = DB

其他配置项保持不变,如果要禁用OMCR的迁移功能,则将ampcfg.ini中所有MaxTakeover项设置为0。

十一、客户端配置

客户端需要配置两条服务器的IP地址连接,才能保证迁移发生时客户端可以正确连接服务器。

$OMCHOME/conf/syscfg.ini,需要包括以下几行:

[LOCAL]

MNo = 203

Ip = 172.31.1.12

IsRemote = 0

DOMAINNUM = 1

[DOMAIN1]

ALIAS = where

NEID =

SvrNum = 2

SvrMNo1 = 129

SvrMNo2 = 130

SvrIP1 = 172.31.1.14

SvrIP2 = 172.31.1.13

启动

$ourmainproc oracle

shexiaoyu@hotmail.com

| www326yu 回复于:2004-06-13 03:42:02 |

| 心跳是Cluster必须要的,不论是什么Cluster都会有心跳,这是它的设计思想,如果没有心跳那这个Cluster不是一个真正意义上的Cluster,但VERITAS则可有可无,卷管理可以用其它的软件 |

| nimysun 回复于:2004-06-13 10:02:54 |

| 感谢楼主这种革命大无畏的共享精神!

这帖,俺收下了。 |

| unixli 回复于:2004-06-14 15:09:26 |

| 你这样做不算是cluster,应该叫负载均衡更合适。

请问楼主现在在用吗?现在两台服务器都启了oracle吗?还是只能启一台? |

| Philmoon 回复于:2004-06-14 16:33:57 |

| 通过软件来实现双机或负载均衡有多种方法,心跳线也有多种实现。比如ROSE HA可以用私网、公网、串口等方式。VERITAS的CLUSTER(VCS)最早出来时也是用公用阵列上的一个小区来判断对方的状态,后来才发展到用私网。 |

| superwater 回复于:2004-06-14 21:06:28 |

| OMCR?电信运营商吧?呵呵 |